Déroulement

Il y a 1 semaine

Dans 3 mois

Dans 4 mois

Citation

Les auteurs

Olivier Mamavi

(omamavi@gmail.com) - Paris School of Business - ORCID : https://orcid.org/0000-0002-6421-1048Romain ZERBIB

(romainzerbib@yahoo.fr) - ICD Business School

Copyright

Déclaration d'intérêts

Financements

Aperçu

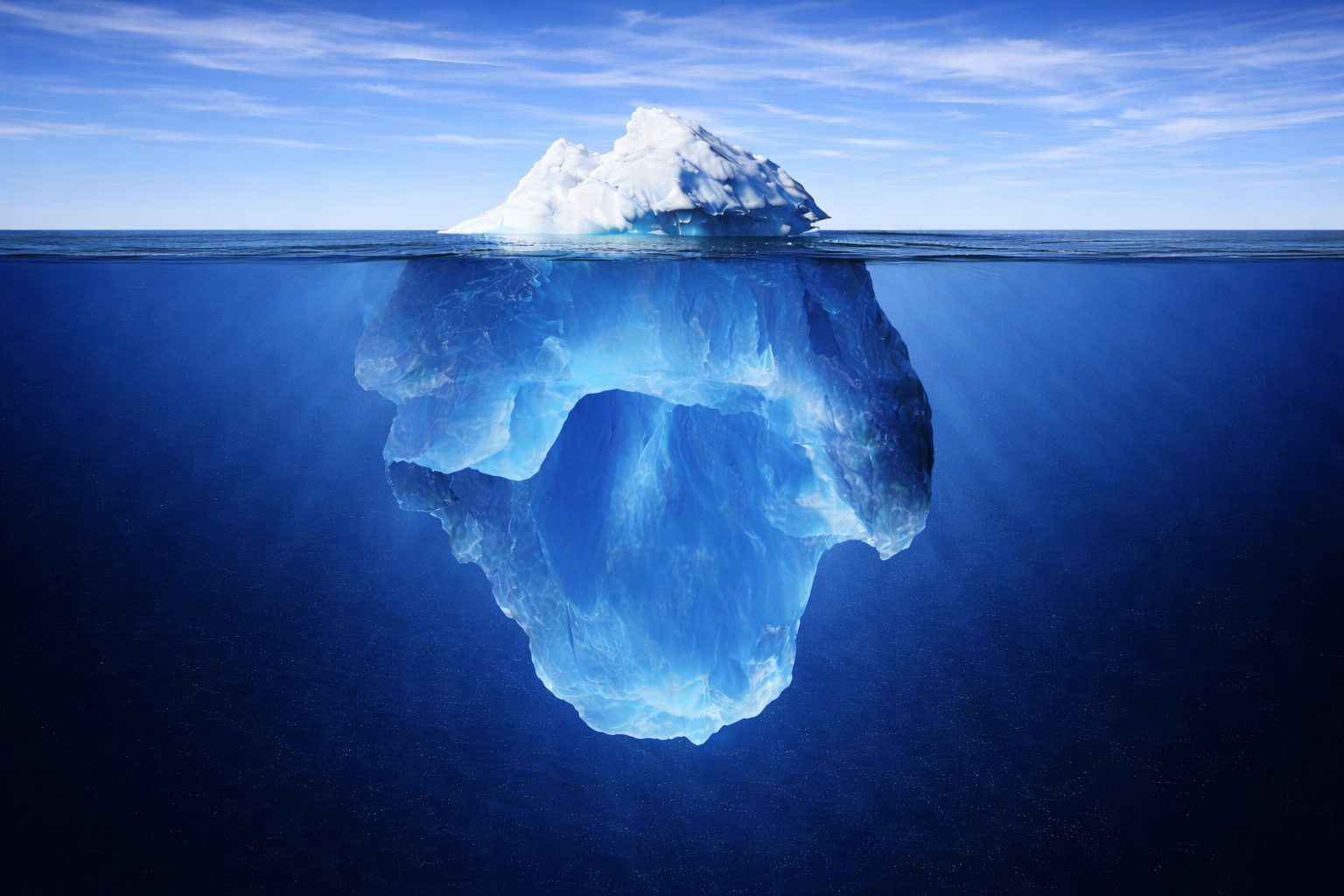

L’intelligence artificielle s’impose progressivement comme un levier de transformation des modes de fonctionnement des organisations. Mais au-delà des gains attendus, une réalité plus difficile à saisir mérite d’être examinée : celle de coûts cachés, diffus, rarement mesurés, et pourtant susceptibles de peser durablement sur la création de valeur.

Ces coûts ne relèvent pas uniquement de dimensions financières directement observables. Ils prennent souvent la forme d’effets indirects, liés aux conditions concrètes d’intégration des systèmes d’IA dans les pratiques réelles de travail : temps d’appropriation, ajustements organisationnels, charges cognitives, désalignements ou encore pertes de fluidité dans les processus.

Cet appel à contributions pour la revue Management & Data Science propose d’explorer ces coûts, non seulement pour en préciser la nature, mais surtout pour comprendre comment les identifier, les rendre visibles et les piloter, afin de permettre aux projets d’IA de produire des effets réellement maîtrisés au sein des organisations.

Contenu

Les projets d’intelligence artificielle se multiplient. Les organisations investissent, expérimentent, déploient, avec, dans de nombreux cas, des résultats tangibles.

Et pourtant, un constat persiste :

les effets observés restent souvent en deçà des transformations attendues.

Ce décalage ne tient pas uniquement à des limites techniques, ni à un défaut de performance des modèles.

Il renvoie plus largement à ce que ces dispositifs laissent en dehors de leur périmètre d’analyse :

les conditions concrètes de leur intégration dans le travail et dans l’organisation.

Car entre un système qui produit des résultats et une organisation qui se transforme effectivement,

il existe un espace intermédiaire.

Un espace fait de frictions, d’ajustements, d’apprentissages progressifs, mais aussi d’incompréhensions ou de résistances… autant de dynamiques qui ne relèvent pas du modèle lui-même, mais de son inscription dans des pratiques concrètes.

C’est dans cet espace, rarement formalisé mais déterminant, que prennent forme les coûts cachés de l’IA.

Les coûts cachés de l’IA en organisation : définition, manifestations et enjeux de pilotage

La notion de coût caché renvoie à une tradition bien établie en sciences de gestion, notamment dans les travaux de Henri Savall, qui définit ces coûts comme des dysfonctionnements organisationnels non directement visibles dans les systèmes comptables, mais produisant des effets économiques réels et durables.

Appliquée aux projets d’intelligence artificielle, cette notion permet de dépasser une lecture strictement technique ou financière pour appréhender les effets indirects de ces dispositifs sur le fonctionnement des organisations.

Dans cette perspective, un coût caché ne correspond pas nécessairement à une dépense identifiable, mais à un écart entre le fonctionnement attendu et le fonctionnement réel de l’organisation, générant des pertes d’efficacité, de coordination ou d’engagement.

Ces coûts se manifestent notamment par :

- des temps de régulation non formalisés (vérification, correction, interprétation des résultats produits par l’IA) ;

- une augmentation de la charge cognitive et décisionnelle, liée à l’interprétation et à la responsabilité des recommandations algorithmiques ;

- des dysfonctionnements organisationnels (désalignements, fragmentation des processus, dépendances accrues) ;

- des coûts sociaux et relationnels (perte de sens, tensions, résistances, désengagement) ;

- des écarts entre usage prescrit et usage réel, révélant des difficultés d’appropriation ou des inadéquations entre conception et pratiques.

Ces éléments ont en commun d’être peu visibles à court terme, rarement intégrés dans les dispositifs de pilotage, mais susceptibles d’affecter durablement la performance globale des organisations.

Dans le prolongement de ces travaux, l’enjeu n’est pas seulement de constater l’existence de ces coûts, mais de les rendre intelligibles, mesurables et pilotables, afin d’en faire des objets à part entière du management des projets d’IA.

Problématique et questions centrales

La question n’est plus de savoir si l’IA fonctionne sur le plan technique.

L’enjeu se déplace :

il s’agit désormais de comprendre ce que coûte réellement son intégration dans les organisations,

et surtout comment agir sur ces coûts pour en maîtriser les effets.

Dans cette perspective, ce numéro s’organise autour de trois tensions structurantes :

- Équiper vs transformer : comment dépasser une logique d’accès aux outils pour produire une transformation effective des pratiques de travail ?

- Promesse vs réalité : comment analyser et réduire les écarts entre les bénéfices attendus et les résultats effectivement observés ?

- Performance technique vs performance organisationnelle : comment faire en sorte qu’un modèle performant devienne réellement utile, compréhensible et mobilisable dans l’action ?

Objectifs du numéro spécial

Ce numéro vise à :

- identifier et caractériser les coûts cachés associés aux projets d’IA ;

- analyser les mécanismes organisationnels qui les génèrent et les entretiennent ;

- mettre en évidence des leviers d’action concrets permettant de :

- anticiper ces coûts en amont des projets,

- en limiter les effets au cours du déploiement,

- ou les transformer en opportunités d’apprentissage organisationnel ;

- formuler des principes de pilotage directement mobilisables par les managers et les décideurs.

L’ambition est ainsi de produire une contribution à la fois analytique et opérationnelle, articulant compréhension des phénomènes et propositions d’action.

Axes et principaux thèmes attendus

Les contributions doivent s’appuyer sur des situations concrètes et intégrer une double exigence :

analyse des coûts cachés + propositions de leviers d’action

Axe 1. Décider un projet IA : entre rationalité et mimétisme

Analyser les logiques explicites et implicites qui orientent les décisions de lancement (pression concurrentielle, effets de mode, injonctions internes) et proposer des cadres permettant de mieux qualifier la pertinence stratégique des projets en amont.

Axe 2. L’illusion d’adoption

Identifier les indicateurs d’adoption trompeurs (taux d’usage, volume de requêtes, accès aux outils) et proposer des métriques plus robustes permettant d’évaluer la transformation effective des pratiques.

Axe 3. Le coût de la non-appropriation

Objectiver l’écart entre potentiel technologique et usages réels, et analyser les facteurs organisationnels qui freinent l’appropriation, en proposant des dispositifs concrets pour la favoriser.

Axe 4. IA et identités professionnelles

Analyser les effets de l’IA sur les représentations des métiers, les dynamiques d’engagement et de résistance, et proposer des approches d’accompagnement adaptées aux transformations des rôles.

Axe 5. Le rôle du management de proximité

Identifier les points de blocage au niveau des équipes et analyser le rôle des managers dans la traduction des orientations stratégiques en pratiques opérationnelles, en proposant des leviers d’action concrets.

Axe 6. Le coût de l’acculturation

Décrire les processus réels d’apprentissage (temps, essais, ajustements) et proposer des dispositifs de montée en compétence cohérents avec les contraintes opérationnelles.

Axe 7. Le coût cognitif

Analyser les effets de l’IA sur la charge mentale, la prise de décision et la responsabilité, et proposer des modalités de conception et d’usage permettant de limiter ces coûts.

Axe 8. La construction de la confiance

Identifier les déterminants de la confiance dans les systèmes d’IA (compréhension, transparence, fiabilité perçue) et proposer des leviers concrets pour en favoriser l’installation durable.

Axe 9. Les usages déviés et la shadow AI

Analyser les pratiques de contournement et les usages non prescrits comme indicateurs de décalage organisationnel, et proposer des modes de pilotage permettant de les intégrer plutôt que de les contraindre.

Axe 10. Dynamiques collectives et adoption

Comprendre les mécanismes sociaux qui structurent l’adoption ou la résistance (effets d’entraînement, normes de groupe, leadership informel) et proposer des stratégies d’intégration à l’échelle des collectifs.

Axe 11. Le coût des promesses non tenues

Analyser les effets des écarts entre attentes initiales et résultats observés sur l’engagement des acteurs, et proposer des modalités de cadrage et de pilotage plus réalistes des projets.

Axe 12. Mesurer l’adoption réelle

Dépasser les indicateurs classiques pour proposer des outils de mesure capables de capter la transformation effective des pratiques et des modes de fonctionnement.

Axe 13. Le passage à l’échelle

Identifier les ruptures entre phases d’expérimentation et déploiement à grande échelle, et proposer des conditions organisationnelles favorisant une intégration durable.

Axe 14. Alignement stratégique et cohérence organisationnelle

Analyser les effets des désalignements entre initiatives IA et priorités stratégiques, et proposer des mécanismes assurant une cohérence d’ensemble.

Axe 15. Vers une appropriation réussie

Formuler une synthèse de principes d’action structurés, directement mobilisables par les managers pour piloter l’intégration de l’IA dans les organisations.

Les propositions sont courtes (autour de 2000 mots, voir le guide des auteurs). L’ensemble des formats de réponses ci-dessous sont acceptés :

- Soumettre un article scientifique

- Soumettre une étude de cas ou retour d’expérience

- Soumettre un avis d’expert

Les contributions doivent se faire directement via la plateforme Management & Datascience à partir de l’onglet « Participer ». Pensez à vous inscrire sur la plateforme au préalable. Une fois connecté, cliquez sur «Contribuer» pour créer votre article.

Les meilleures contributions seront sélectionnées pour constituer un ouvrage collectif publié en fin d’année 2026 dans la collection IA & Management et rassemblera les travaux les plus pertinents issus de ce numéro spécial.

Références

Les références ci‑dessous sont proposées comme points d’appui (elles ne constituent ni une liste exhaustive, ni une doctrine).

Brynjolfsson, E., Rock, D., & Syverson, C. (2021). The productivity J-curve: How intangibles complement general purpose technologies. American Economic Journal: Macroeconomics, 13(1), 333–372.

Brynjolfsson, E., & Hitt, L. M. (2000). Beyond computation: Information technology, organizational transformation and business performance. Journal of Economic Perspectives, 14(4), 23–48.

Bresnahan, T. F., Brynjolfsson, E., & Hitt, L. M. (2002).

Information technology, workplace organization, and the demand for skilled labor. Quarterly Journal of Economics, 117(1), 339–376.

Savall, H., & Zardet, V. (2004). Recherche en sciences de gestion : approche qualimétrique. Observer l’objet complexe. Paris : Economica.

Savall, H., & Zardet, V. (2011). Ingénierie stratégique du roseau. Paris : Economica.

Orlikowski, W. J. (2000). Using technology and constituting structures: A practice lens for studying technology in organizations. Organization Science, 11(4), 404–428.

Leonardi, P. M. (2011). When flexible routines meet flexible technologies: Affordance, constraint, and the imbrication of human and material agencies. MIS Quarterly, 35(1), 147–167.

Jarrahi, M. H. (2018). Artificial intelligence and the future of work: Human-AI symbiosis in organizational decision making. Business Horizons, 61(4), 577–586.

Rudin, C. (2019). Stop explaining black box machine learning models for high stakes decisions and use interpretable models instead. Nature Machine Intelligence, 1, 206–215.

Müller, D. (2018). Economics of human-AI ecosystem: Value bias and lost utility in multi-dimensional gaps. arXiv preprint arXiv:1811.06606.

il ne peut pas avoir d'altmétriques.)