Citation

Les auteurs

Patrice REIS

(reis@gredeg.cnrs.fr) - université Côte d'Azur - ORCID : https://orcid.org/0000-0002-6043-2222Laurence SAGLIETTO

(laurence.saglietto@univ-cotedazur.fr) - (Pas d'affiliation)

Copyright

Déclaration d'intérêts

Financements

Aperçu

Contenu

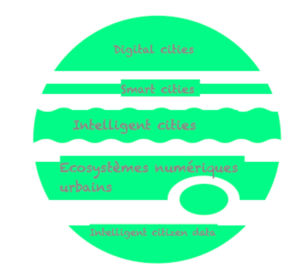

La société se transforme sous l’impulsion d’algorithmes et d’espaces numériques toujours plus extensifs et plus collaboratifs. Le milieu dans lequel nous évoluons est composé de strates dans lesquelles des « capteurs, connecteurs, interfaces, algorithmes sont des actants nouveaux qui fabriquent ce monde et le peuplent» et qui interagissent avec des humains pour former le « plissement numérique du monde» (Noyer, 2017). Pour illustrer ce phénomène, la littérature évoque souvent l’architecture urbaine et la manière dont les technologies de l’information et de la communication affectent la condition des villes (Noyer, 2017; Carmes et Noyer, 2014). Ce plissement numérique spatial aborde l’organisation des digital cities[1] (Ishiba et Isbister, 2000; Alizadeh, et Iveson, 2020), des smart cities[2] (Hollands, 2008; Albino et al., 2015; Halegoua, 2020), et des intelligent cities[3] (Komninos 2002; Komninos 2008; Soares et al., 2021) (cf. figure 1).

Figure 1 : Le plissement numérique

Plus avant dans la particularisation de ce plissement numérique, les écosystèmes numériques urbains portent un regard sur l’organisation des villes et s’articulent autour de parties prenantes et d’objectifs spécifiques à des fins d’amélioration de la qualité de vie des citoyens (Gomez-Carmona et al. 2008). En optant pour une approche centrée sur l’humain, le plissement numérique concentre in fine son attention sur la production et le croisement numérique de données personnelles sur les citoyens. Ce qui constitue une catégorie que nous nommerons intelligent citizen data [4] (Barthelemy et al., 2017) et qui met en avant les bases de données urbaines des citoyens dans le développement des villes (Barthelemy et al., 2017).

Les données personnelles combinées à l’Internet des objets (Parachkevova-Racine et al., 2020) illustrent un environnement numérique spécifique dans lequel ces données sont reliées à des innovations permanentes (RFID, surveillance vidéo, traçabilité sur les réseaux sociaux). D’autres innovations sont proposées au titre du bien-être (dossiers médicaux, services publics en ligne – impôts…) ou de la protection juridique des données des utilisateurs (suppression des données personnelles sur les réseaux sociaux, adoption du RGPD européen, de la loi du 25 juin 2018 adaptant le droit interne au droit européen en la matière[5]…). Le sujet de droit est ainsi conçu non plus comme un individu, mais comme un simple émetteur de données.

Dès lors, ces avancées technologiques peuvent être considérées comme intrusives au regard des enchevêtrements possibles lors d’analyses judiciaires, par exemple. L’accessibilité et le partage de ces données notamment personnelles sont plus que jamais d’actualité et posent avec acuité le rôle de cet écosystème intelligent citizen data (ICD) autour des bases de données des fichiers d’analyse sérielle (FAS), cœur de l’analyse judiciaire et de la sécurité intérieure. L’efficacité promise par la révolution numérique de ces interrelations administrations / entreprises privées peuvent être considérées comme intrusives ce qui conduit à s’interroger sur leur légitimité démocratique (Teller, 2022).

L’écosystème Intelligent citizen data (ICD)

La loi du 11 Mars 2011[6] d’orientation et de programmation pour la performance de la sécurité intérieure consacre la section 2, aux fichiers d’analyse sérielle[7]. Ils sont considérés comme « une nouvelle technique d’enquête », qui « n’est pas réservée aux serial killers, mais au plus grand nombre, c’est-à-dire à chacun de nous. Pour que cela fonctionne, il faut recueillir un maximum de renseignements sur un maximum de gens. Ensuite, le policier lance son filet, aux mailles plus ou moins fines, et il fait le tri » (Moreas, 2009). Cette loi relance le débat sur l’utilisation et l’utilité d’un traitement massif de données à caractères personnelles au regard des interconnexions numériques qu’elles nécessitent et des réflexions qu’elles soulèvent face au Digital Services Act européen (DSA).

L’objet d’étude

L’analyse sérielle est fondée sur l’analyse séquentielle d’un grand nombre de fragments d’informations ayant trait à la vie privée et/ou publique qui personnifient la signature d’un citoyen. Les FAS sont présentés par le législateur comme un outil de l’intelligence économique au service de la lutte contre la cybercriminalité. Le cœur de l’écosystème est donc constitué des FAS[8] « des traitements automatisés de données à caractère personnel » dénommés : « bases d’analyse sérielle de police judiciaire, ayant pour finalité de rassembler les preuves et d’identifier les auteurs, grâce à l’établissement de liens entre les individus, les événements ou les infractions, des crimes et délits présentant un caractère sériel » (Articles 230-12 à 230-18 CPP, article 1 Décret n° 2013-1054 du 22 novembre 2013 relatif aux traitements automatisés de données à caractère personnel dénommés « bases d’analyse sérielle de police judiciaire »).

Les traitements d’analyse sérielle ne peuvent concerner que les crimes ou délits portant atteinte aux personnes passibles d’emprisonnement. Le spectre des données collectées dans ces fichiers concerne un grand nombre d’individus (suspects, personnes susceptibles de fournir des renseignements sur les faits et victimes des infractions).

La saisie de ces données dans les fichiers s’effectue durant « les enquêtes préliminaires ou de flagrance ou des investigations exécutées sur commission rogatoire et concernant toute infraction punie d’au moins cinq ans d’emprisonnement, soit à l’occasion de procédures de recherche des causes de la mort ou d’une disparition » (Perrier, 2011).

Les données des personnes mises en cause sont : « l’état civil complet, la nationalité, les élément(s) non biométrique(s) d’identification de titres d’identité, la situation familiale, les adresses, les données de connexion, les numéros (de téléphone, de compte bancaire) …, les signes physiques particuliers, le comportement lors des faits, les photos, les images, les vidéos en lien direct avec l’enquête, les informations sur le mode de transport, les numéro(s) de série armes utilisées, etc. » (Annexe décret op cit.).

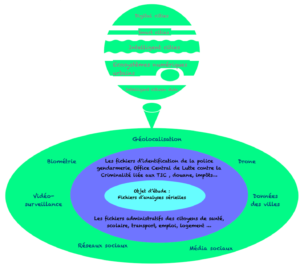

Rapidement, l’enrichissement des données ainsi collectées s’est effectué grâce à des croisements entre les FAS et une grande quantité de données hétérogènes et multiformes issues de différentes sources et traces numériques provenant de tous les fichiers détenus par les autres administrations (gendarmerie, police, douanes, impôts …) et plus récemment de l’IdO des villes et/ou des citoyens eux-mêmes et bases de données des opérateurs privés (FAI et hébergeurs) constituant ainsi un écosystème informationnel conséquent afin d’apprécier le profil des citoyens concernés. Il s’agit de données à caractères personnelles à la fois ouvertes (disponibles sur Internet, les réseaux et médias sociaux) et fermées (biométrie, vidéosurveillance, images de drone, géolocalisation, données urbaines…).

Enfin, le traitement global des données révèle des informations significatives pour le profilage des citoyens. Elles contribuent à l’analyse psychocriminologique (Villerbu, 2008) d’un citoyen à partir de données sur sa personnalité, ses habitudes, ses comportements, ses déplacements, son aspect physique, voire psychologique, afin de bâtir un historique de ces activités et obtenir un « portrait informatisé » (Moreas, 2009).

L’écosystème ICD face au Digital Services Act (DSA)

Cet écosystème d’ICD est composé de big data publics, d’informations provenant d’Internet des Objets et de plateformes numériques. C’est la face visible d’un écosystème puissant à la fois numérique et d’affaires (cf figure 2).

Figure 2 : L’écosystème Intelligent Citizen Data (ICD) et les fichiers d’analyse sérielle

Cette composition est aujourd’hui décisive pour éprouver le règlement européen DSA du 19 octobre 2022 réglementant les activités de nombreux membres de l’écosystème ICD. En effet, le règlement DSA s’applique « aux fournisseurs d’accès à Internet (FAI), les services d’informatique en nuage (cloud) ; les plateformes en ligne comme les places de marché (market places), les boutiques d’applications, les réseaux sociaux, les plateformes de partage de contenus, les plateformes de voyage et d’hébergement et les GAFAM (Google, Apple, Facebook, Amazon et Microsoft) … ». « De plus, les plateformes devront expliquer le fonctionnement des algorithmes qu’elles utilisent » pour leurs diverses recommandations. Le DSA vient ainsi compléter le RGPD utilement, car ce ne sont pas seulement les données personnelles qui sont en cause. Au fil du temps, la contribution de l’écosystème ICD a pris de l’ampleur dans la résolution des affaires ce que les entreprises privées du numérique ont bien assimilé, puisqu’elles vendent, les données recueillies aux forces de l’ordre.

C’est le cas de la société américaine Clearview AI qui « a développé un logiciel de reconnaissance faciale, dont la base de données repose sur l’aspiration d’images publiquement accessibles sur Internet, qui permet d’identifier une personne à partir d’une photographie la représentant »[9] (Crichton, 2022). Grâce à sa plateforme numérique, cette société offre un moteur de recherche de comparaison, par empreintes numériques, pour les photographies. Elle propose ainsi aux forces de l’ordre un moyen d’identifier les auteurs et les victimes d’infractions à partir d’une photographie. « À partir de chaque photographie collectée, la société calcule un gabarit biométrique. Une empreinte numérique unique, propre au visage tel qu’il apparaît sur la photographie est ainsi générée. Les milliards d’images sont ensuite enregistrées dans une base de données sous une forme permettant de les rechercher à l’aide de l’empreinte numérique ». La CNIL a notifié le 14 juillet 2022, les manquements aux dispositions du RGPD et a infligé une amende de 20 millions d’euros à la société assortie d’injonctions sous astreinte par jour de retard de 100000 euros. Cette société a fait un grand pas dans l’analyse de la reconnaissance faciale au niveau de leur contextualisation, créant ainsi du sens et de la valeur tout en soulevant des problèmes d’éthique dans la mesure où le non-respect par Clearview AI des injonctions prononcées en 2022, se traduit par une nouvelle sanction de 5,2 millions d’euros[10] au titre des astreintes par jour de retard. L’entreprise n’a pas dans le délai imparti respecté les injonctions de ne pas procéder, sans base légale, à la collecte et au traitement de données des personnes se trouvant en France, et de supprimer les données de ces personnes après avoir répondu aux demandes d’accès qui lui ont été adressées.

Le DSA vise à combler certaines lacunes du RGPD en poussant les plateformes à intégrer dès la conception des algorithmes des questions de conformité ou de compliance (Frison Roche, 2021 et 2022), qui incarnent une forme d’éthique by design (Beranger, 2018; Merabet 2021), source d’acceptabilité sociale. Dans le cadre du champ d’application du DSA, les sujets de droit ne devraient pas bénéficier ni de moins de droits ni d’une protection moindre que dans un monde hors ligne.

Ouverture de la boîte de Pandore et légitimité démocratique

L’émergence de cet agencement d’informations collectives comme base réflexive sur les citoyens souligne à la fois de la puissance des algorithmes et les dérives sous-jacentes, donnant lieu à une communication paradoxale autour des interactions ICD/FAS. A cet égard, plusieurs points peuvent être évoqués autour de l’écosystème ICD et illustrés par différentes oppositions au regard de la performativité et du respect de la compliance et ce qui influe sur l’acceptabilité sociale et la démocratie algorithmique.

De la performativité au respect de la compliance

Performativité versus intrusion dans la vie privée. Depuis la Loi d’orientation et de programmation pour la performance de la sécurité nationale, la communication sur la performativité des procédures et du traitement des affaires criminelles est monnaie courante. Les FAS, dans la montée en puissance du Big Data, couplés à l’émergence de l’IoD et des plateformes numériques peuvent être perçus comme la volonté d’une maîtrise continue des informations au titre d’une nouvelle gouvernance des populations. D’autant, que la valeur des FAS augmente avec les croisements réalisés avec d’autres fichiers et bases de données. Dans cette quête de puissance, « la performativité d’une politique s’accroît à proportion des informations dont elle dispose concernant son milieu associé » (Noyer, 2017). Néanmoins, cela se fait au détriment d’une intrusion toujours plus forte dans la vie privée dans la mesure où il faut « que ces fichiers soient effectivement tenus à jour, et, notamment que, les effacements qui sont prévus par le code — principalement en cas de relaxe ou d’acquittement définitif — le soient réellement » (Perrier, 2011).

Ethique by design versus non-respect de la compliance. Depuis quelques années, les projets publics et privés font souvent l’objet de contestation autour de l’utilisation du numérique. L’éthique by design ou le codage de l’éthique, est une thématique contemporaine en matière de numérique sur le modèle du privacy by design prévu par le RGPD. L’éthique by design en tant qu’éthique du code (informatique) repose sur l’intégration des considérations éthiques dans la conception même des outils numériques, car le code informatique n’est pas neutre, il a un pouvoir normatif et une force équivalente à celle de la loi (Lessig 1999). La Commission européenne a proposé un cadre de principes numériques dans une communication du 26 janvier 2022 (Communication de la commission européenne du 26 janvier 2022 établissant une déclaration sur les droits et principes numériques pour la décennie numérique COM (2022) 27 final). L’objectif de la communication est déjà présent dans le règlement européen DSA du 27 octobre 2022. Les géants du numérique seraient alors tenus à la conformité, à la compliance du fait de l’insertion au sein des codes informatiques de principes tels que celui de la neutralité, de non-malveillance, voire de bienveillance, source d’une plus grande effectivité de la norme (Merabet, 2021). Il s’agit par cette forme de corégulation de garantir des droits en amont de la création et de la mise en œuvre d’algorithmes tout en mettant en place des procédures de participation des parties prenantes à la gouvernance algorithmique (Teller, 2022). Le cas Clearview AI, est un exemple parlant du non-respect de la compliance qui nécessite au-delà d’une volonté de respect des lois, des investissements importants en ressources humaines et technologiques afin d’en assurer l’application. De même, si le législateur accorde l’accessibilité aux données des FAS et leur croisement avec les données de l’écosystème ICD aux personnels spécialement habilités et individuellement désignés, ce n’est toutefois qu’un droit d’accès et non pas un moyen de contrôle du contenu ou de l’utilisation réelle des FAS. La presse s’est d’ailleurs fait écho de nombreux problèmes à ce sujet.

De l’acceptabilité sociale à la démocratie algorithmique

Acceptabilité sociale versus privacy paradox. L’acceptabilité sociale, dont il est question ici[13], est peu débattue, contestée ou relayée dans la presse, lorsqu’il s’agit des textes législatifs et règlements concernant des relations FAS/écosystème ICD. Bien que présentée comme un enjeu à la fois de sûreté de la ville et de sécurité des citoyens, cette acceptabilité sociale ne va pas initialement de soi, car chaque citoyen a une perception individuelle de l’utilisation de ses données personnelles par l’état, c’est le privacy paradox (Pras, 2012). Chaque citoyen est partagé entre d’une part, le respect de sa vie privée avec un droit de regard sur les données collectées à son sujet et d’autre part, le désir de jouir des bénéfices des nouvelles technologies pour ses besoins personnels. De plus, il apparaît qu’un individu est moins réticent à céder ses données à une entreprise privée plutôt qu’à l’État (Rochelandet, 2010). Le citoyen accepterait donc les relations FAS/écosystème ICD parce qu’il ne pense pas être concerné par le périmètre des personnes impliquées. Ce point de vue est à rapprocher du syndrome NIMBY (not in my backyard). La technologie est acceptée tant qu’elle ne concerne pas directement les citoyens. Certains citoyens y trouveraient même un intérêt. Dans les villes dangereuses les citoyens ont soit une attitude positive envers les relations FAS/écosystème ICD, car qu’ils espèrent être mieux protégés (Voir PIMBY (Please in my backyard) ou YIMBY (Yes in my backyard, syndrome NIMBY spatialement inversé (Bourdin, 2020), soit ils laissent faire par ignorance[14].

Démocratie algorithmique versus domination des GAFAM

La domination des plateformes numériques structurantes telles que les GAFAM ou les BAIDU pose la question de la garantie de la démocratie algorithmique (Teller, 2022), les règlements européens DMA et DSA de 2022 constituent les premières avancées de cette démocratie en mettant en avant le consentement de l’utilisateur au profilage d’une part et d’autre part en imposant des obligations de transparence.

Le règlement européen DMA impose une série d’obligations aux « prestataires, proches des opérateurs de réseaux et services de communications électroniques » qu’il qualifie de « contrôleurs d’accès ou gate-keepers » (Rapp, 2023). Il vise ainsi les plateformes numériques structurantes. Il s’agit ici de compléter le droit européen de la concurrence qui rencontre des difficultés pour appréhender l’ultradominance de ces plateformes sur des marchés bifaces ou multifaces. Le règlement s’applique quelque soit le lieu d’implantation de la plateforme il suffit qu’elle intervienne sur le marché européen ce qui lui confère une forme de portée extraterritoriale comme le RGPD ce qui juridiquement est faux, car il y a un effet sur le territoire de l’UE. L’article 5 du DMA impose une série d’obligations à la fois pour protéger les consommateurs et pour favoriser la concurrence sur les marchés (Crichton, 2021). Ainsi à titre d’exemple le règlement interdit aux contrôleurs d’accès de croiser les données personnelles des utilisateurs avec celles d’autres données de leurs services sans leur consentement (Crichton, 2021). Cette interdiction aura un impact certain sur le profilage, mais aussi la personnalisation des prix auxquels se livrent habituellement ces plateformes. Pour mettre en place l’ensemble des obligations du DMA, le contrôleur d’accès est soumis à un protocole de compliance (art. 7), de mise en conformité (art. 11) et d’audit concernant les techniques de profilage des consommateurs qu’il utilise (art. 13). Le consentement des utilisateurs ainsi que les programmes de conformité et de compliance destinés à assurer le respect des obligations du DMA sont aussi assortis de sanctions pécuniaires de nature administratives particulièrement dissuasives complétées par la possibilité d’un démantèlement (Saillant, 2023)..

Le règlement DMA est complété côté utilisateur par le règlement Digital Services Act du 19 octobre 2022 qui a pour objectif de mettre en place une plus grande transparence sur les marchés numériques en visant notamment les grandes plateformes structurantes. Ces dernières doivent certes informer les utilisateurs de leurs pratiques, recueillir leurs consentements, mais elles doivent « recenser, analyser, et évaluer de manière diligente, tous risques, systémique au sein de l’Union européenne, découlant de la conception, du fonctionnement, de leurs services et de leurs systèmes connexes, y compris, des systèmes algorithmiques, ou de l’utilisation faite de leur service ». Cette évaluation des risques tient compte, notamment « de la conception, de leur système, de recommandation et de tout autre système algorithmique pertinent » (article 34 paragraphe 2 a du DSA). Ces obligations de transparence, d’information, d’évaluation et de gestion des risques sont là encore assorties de sanctions dissuasives.

Conclusion

La société se transforme sous l’impulsion du big dada, des algorithmes et de l’IA créant de nouveaux espaces urbains toujours plus connectés autour d’axes épistémiques permettant la compréhension des interactions au sein des écosystèmes numériques urbains par exemple. Dans ce contexte, nous avons souhaité aborder comme objet d’étude les FAS et leur écosystème ICD. La présentation des différents niveaux d’analyse de l’écosystème a été un moyen d’approfondir :·

- les interrelations entre la sphère publique et la sphère privée autour des enjeux du croisement numérique de données personnelles (composé de Big data public (avec ou sans accord d’accessibilité), d’informations provenant de l’Internet des Objets et de plateformes numériques ;

- les rapports de pouvoir qui se nouent entre les acteurs du système judiciaire, les GAFAM et la réglementation émergente (RGPD et DSA) pour la régulation de l’écosystème, l’articulation des processus législatifs par le biais de nouveaux outils ;·

- la compréhension de l’action juridique dans ses transformations actuelles qui recouvrent à la fois des dynamiques de transnationalisation des pratiques et une complexité croissante de la décision au regard d’une communication paradoxale des thèmes qui l’entourent.

Malgré tout, la juridicisation concernant des données personnelles reste un débat ouvert.

Notes de bas de page

[1] Villes mobilisant de la technologie numérique dont les 4 piliers sont la connectivité : numérique, des services, de la culture et de la durabilité.

[2] Villes intelligentes tournées vers le développement durable.

[3] Villes intelligentes dont l’engagement dans l’intelligence artificielle est une priorité nationale dans les domaines suivants : entreprise et affaires, recherche et innovation, politique gouvernementale, et/ou infrastructure habilitante.

[4] Exemple : « Les données de géolocalisation générées par les téléphones mobiles, les cartes de transport, encapsulées dans les tweets, etc. nous renseignent en effet sur les « rythmes » et « formes » de l’activité urbaine » (Barthelémy et al., 2017).

[5] Règlement UE n° 2016/679 du Parlement européen et du Conseil du 27 avril 2016 relatif à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données : JOUE n° L 119, 4 mai 2016, p. 1. Pour une présentation et des commentaires de ce texte voir Peyrou, 2016 ; Brunet 2016 ; Debet, 2016 ; Mattatia et Mordelet, 2017 ; Gateau et Faron, 2017 et sur la loi du 25 juin 2018 voir Lecourt (2019).

[6] Loi n° 2011-267 du 14 mars 2011 d’orientation et de programmation pour la performance de la sécurité intérieure. Code de procédure pénale – Section 2 : Des fichiers d’analyse sérielle (V) (Articles 230-12 à 230-18).

[7] Au Titre IV du Livre Ier du Code de procédure pénale deux nouveaux chapitres II et III régissant quatre catégories de fichiers de police : les fichiers d’antécédents (CPP, art. 230-6 à 230-11), les fichiers d’analyse sérielle (CPP, art. 230-12 à 230-18), les fichiers des personnes recherchées (CPP, art. 230-19) et les logiciels de rapprochement judiciaire (CPP, art. 230-20 à 230-27).

[8] Les bases des FAS peuvent être considérés comme des « big data », dont ils possèdent toutes caractéristiques : volumétrie des données, vélocité, variété, véracité et visibilité.

[9] Elle « utilise une technologie propre pour indexer les pages web librement accessibles. Cette collecte concerne des images de personnes majeures comme mineures, aucun filtre n’étant appliqué à cet égard». CNIL 17 oct. 2022, délib. n° SAN-2022-019, JO 20 oct. – Crichton (2022).

[10] https://www.cnil.fr/fr/reconnaissance-faciale-la-cnil-liquide-lastreinte-prononcee-lencontre-de-clearview-ai.

[11] La communication paradoxale est le cadre méthodologique de discussion que nous avons mobilisé suite à l’analyse de l’ICD et des FAS, par le prisme des textes législatifs, la réglementation et d’exemples. Elle permet de mettre en avant deux messages qui se qualifient l’un l’autre de manière conflictuelle.

[12] Selon Perrier (2011) « À cet égard, on signalera que les décisions de non-lieu et de classement sans suite ne conduisent pas à un effacement des données ; la loi précise seulement qu’il en sera fait mention dans le fichier. Cette distinction de traitement entre non-lieu et relaxe est assez surprenante, car le non-lieu implique, le plus souvent, que les charges sont tellement faibles que l’instruction n’est pas allée jusqu’au renvoi ; on pourrait donc considérer que l’innocence est au moins aussi nette en cas de non-lieu qu’en cas de relaxe, spécialement lorsque celle-ci est rendue, finalement, au bénéfice du doute… ».

[13] Légitimité d’une technologie ou d’une pratique bien perçue, apprécier en confiance.

[14] En 2012, B. Pras, expliquait déjà qu’en France « la fusion de données publiques (en provenance d’administrations : santé, police, etc.) et privées n’est pas autorisée, sauf à la demande expresse de l’administration pour des questions de sécurité ou de fraude ». Tandis qu’aux Etats-Unis, « l’ensemble des données privées peut être communiqué aux autorités gouvernementales sans contrôle judiciaire au titre de la cybersécurité. Les informations ( …) font l’objet de plus en plus d’attention, de profilage, voire de discrimination, et leur exploitation n’est le plus souvent pas contrôlée par les individus, voire pas connue ».

Bibliographie

Albino, V., Berardi, U., Dangelico, R. M. (2015), Smart cities : Definitions, dimensions, performance, and initiatives. Journal of urban technology, 22(1), 3-21.

Alizadeh, T. and Iveson, K., (2020), Digital cities. Understanding urbanism, in: Rogers, D., Keane, A., Alizadeh, T., Nelson, J. (eds) Understanding Urbanism. Palgrave Macmillan, Singapore.

Barthelemy, M., Carra, G., Gallotti, R., Louail, T., & Louf, R. (2017), Le rayonnement culturel des musées parisiens, une analyse par les big data. Le cas de Twitter, Mairie de Paris ; CEA-Commissariat à l’énergie atomique et aux énergies alternatives ; CNRS – EHESS.

Beranger J. (2018), le code éthique algorithmique, l’éthique au chevet de la révolution numérique, Edition ISTE.

Bourdin S. (2020), Le NIMBY ne suffit plus! Étude de l’acceptabilité sociale des projets de méthanisation. L’Espace Politique. Revue en ligne de géographie politique et de géopolitique, (38).

Brunet E. (2016), Règlement général sur la protection des données à caractère personnel – Genèse de la réforme et présentation globale, in Dossier, « Les grands axes du règlement (UE) 2016/679 sur les données personnelles » : Dalloz IP/IT 2016, p. 567 s. ;

Carmes M., Noyer J.M., (2014), Désirs de data. Le trans et post humanisme comme horizons du plissement numérique du monde, in Carmes M., Noyer J.M, Devenirs Urbains, Collection Territoires Numériques, Ed. Presses des Mines, pp378.

Crichton C. (2021), « Le Digital Market Act, un cadre européen pour la concurrence en ligne ». Dalloz actualité. Article 5 point a. du DMA.

Crichton C. (2022), reconnaissance faciale : sanction de CLAIRVIEW AI par la CNIL, Dalloz IP/IT 9/11/2022.

Debet A. (2016), Les nouveaux instruments de conformité, in Dossier, « Les grands axes du règlement (UE) 2016/679 sur les données personnelles » : Dalloz IP/IT 2016, p. 592 s.

Frison Roche M.A (2021), Les outils de la Compliance, série « Régulations & Compliance », Journal of Regulation & Compliance (JoRC) et Dalloz 2021.

Frison Roche M.A (2022), Les Buts Monumentaux de la Compliance, série « Régulations & Compliance » Journal of Regulation & Compliance (JoRC) et Dalloz, 2022.

Gateau C. et Faron P. (2017), Retour sur la création de l’action de groupe en matière de données personnelles en droit français, RLDI 2017, n° 5018, p. 45 ;

Gomez-Carmona, O., Casado-Mansilla, D., Lopez-de-Ipiña, D. (2008), Multifunctional interactive furniture for smart cities. Proceedings, 2(19), p1212.

Halegoua, G., (2020), Smart cities. MIT Press.

Hollands, R., (2008), Will the real smart city please stand up ? City,12(3), 303–320.

Ishida, T., and Isbister, K., (2000), Digital cities: technologies, experiences, and future perspectives. Springer Science & Business Media, Lncs v1765.

Komninos, N. (2002), Intelligent cities: innovation, knowledge systems and digital spaces, London and New York, Taylor and Francis, Spon press.

Komninos, N.(2008), Intelligent cities and globalisation of innovation networks. Routledge.

Lecourt A. (2019), RGPD : nouvelles contraintes, nouvelles stratégies pour les entreprises, Dalloz IP/IT 2019 p.205.

Lessig L. (1999), Code: And Other Laws Of Cyberspace, Basic Books, 320p.

Mattatia F. et Mordelet F. (2017), La mise en œuvre du RGPD au prisme du risque juridique, RLDI 2017, n° 5066, p. 61.

Moreas, G., (2009), Le fichier d’analyse sérielle : nouvelle technique d’enquête, Le Monde, 29 mai.

Merabet S. (2021), La morale by design, in M.-A. Frison Roche (dir.) op cit. Dalloz, 2021 p. 287-298.

Noyer J.M., (2017), L’Internet des Objets, l’Internet of “Everything” : quelques remarques sur l’intensification du plissement numérique du monde. Open Science-Internet des objets, 17(1), p1.

Parachkevova-Racine, I, Racine J.B, Marteu T., (2020) Droit et objets connectés, Ed Larcier.

Perrier J.B. (2011), Chronique législative. Revue de science criminelle et de droit pénal comparé, 2011/2, 425-465

Peyrou S. (2016), Le nouveau règlement général européen relatif à la protection des données à caractère personnel : un texte à la hauteur de ses ambitions : RAE-LEA 2016/1, p. 103 s.

Pras B. (2012), Entreprise et vie privée. Le privacy paradox et comment le dépasser ?, Revue française de gestion, 2012/5 (N° 224), p. 87-94.

Rapp L. (2023), B. Digital Market Act . Répertoire de droit européen, Télécommunications et communications électroniques Eur. Février 2023. point 140.

Rochelandet F. (2010), Économie des données personnelles et de la vie privée. Paris: La Découverte.

Saillant C. (2023), Google face à la justice américaine : le démantèlement aura-t-il lieu ? » Dalloz actualité.

Soares, N., Monteiro, P., Duarte, F. J., & Machado, R. J. (2021), Reference models for intelligent cities: an aligned template. In developing and monitoring smart environments for intelligent cities, 28-60. IGI Global Editions.

Teller M. (2022), Vers l’acceptabilité sociale des algorithmes ou comment passer de l’algocratie à la démocratie algorithmique, Revue pratique de la prospective et de l’innovation, mai, n°1, p.27-31.

Villerbu, L. (2008), Identification et sérialité : de la police scientifique à l’analyse psycho-criminologique, Collection Sciences criminelles, Paris, Le Harmattan 2008.

Crédits

Patrice Reis, Professeur des Universités, Université Côte d’Azur, Faculté de droit, GREDEG CNRS – patrice.reis@univ-cotedazur.fr

Laurence Saglietto, Professeur des Universités, Université Côte d’Azur, IAE Nice, GREDEG CNRS – laurence.saglietto@univ-cotedazur.fr