Citation

Les auteurs

Violette BOUVERET

(bouveret@escpeurope.eu) - ESCP Business SchoolSandrine MACÉ

(mace@escpeurope.eu) - ESCP Business School

Copyright

Déclaration d'intérêts

Financements

Aperçu

Contenu

Introduction

Avec un nombre d’objets connectés estimé à 4 à 6 par personne dans les 5 ans (Gartner, 2017), l’IoT a de quoi faire rêver les entreprises de par les perspectives de gains financiers et opérationnels qui pourraient en résulter. Par exemple, McKinsey (2016) évalue à plus de 1 500 milliards de dollars les gains liés à l’exploitation des données issues des voitures et de la mobilité partagée d’ici 2030, données collectées en partie grâce aux objets connectés embarqués dans le véhicule. Cet engouement est d’autant plus fort que les innovations technologiques dans le big data, l’intelligence artificielle et la robotique élargissent le champ des possibles et que la flexibilité du cadre juridique qui se met en place au travers de la GDPR permet des programmes de relation client innovants.

Cependant, toute cette effervescence autour des potentialités de l’offre a tendance à détourner les entreprises de la question essentielle de la perception client : qu’en pense l’usager ? Qu’est-ce qui peut l’inciter à adopter ou au contraire à se détourner des objets connectés ? La question se pose d’autant plus que de nombreux signaux laissent à penser que l’adoption de ces objets pourrait être freinée par les peurs qu’ils suscitent auprès des usagers. Par exemple, l’étude menée par IFOP pour la société Hiscox (2016), montre que lorsqu’il s’agit d’objets connectés, 68% des personnes interrogées déclarent que leurs données sont mal protégées et 76% refusent de les partager. Les peurs des clients sont liées entre autres à l’exploitation des données et au développement de l’intelligence artificielle alimentées par le fantasme d’un développement technologique dépourvu d’éthique et sur lequel l’humain n’aurait pas de contrôle. Récemment, Elon Musk clame ainsi que l’intelligence artificielle va détruire l’emploi et pourrait mener à la 3ème guerre mondiale, Stephen Hawkins avertit que nous sommes arrivés à un point de non-retour et que l’intelligence artificielle va remplacer l’humanité tandis que des séries comme Westworld ou RealHumans anticipent un futur destructeur. Des peurs nourries également par des faits médiatisés allant de l’accident mortel causé par une voiture autonome Tesla en 2016 à une préparation de cyberattaque dénoncée par l’entreprise de sécurité informatique Check Point fin 2017, selon laquelle un million d’objets connectés aux codes trop simples auraient été infiltrés par un logiciel malveillant afin de faire tomber les serveurs des e-commerçants et exiger des rançons.

La puissance de la connectivité de l’IoT au cœur des fantasmes menaçant son adoption

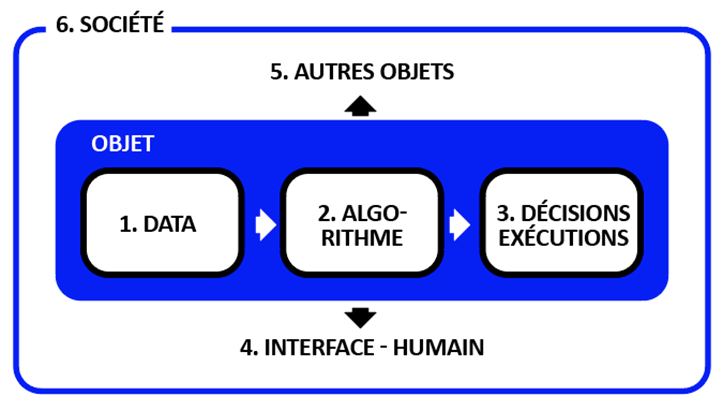

Ce contexte paradoxal d’un objet connecté qui attire autant qu’il repousse s’explique par la puissance de la connectivité de l’objet qui d’un côté, laisse espérer au client des services de grande qualité mais qui de l’autre, inquiète par sa dimension intangible, invisible et bien souvent inconnue de l’utilisateur ou alors perçue comme intrusive dans la vie de l’usager. La connectivité s’étend sur 6 dimensions représentées dans la figure 1 : les données recueillies par les capteurs, les algorithmes et l’intelligence artificielle qui interprètent les données recueillies et produisent de la connaissance au service du client, les décisions et actions exécutées par l’objet à l’issue du traitement des données, l’interface entre l’objet et l’utilisateur (la capacité de communication et d’interaction avec des utilisateurs humains), l’interfaçage entre l’objet et un ou plusieurs autres objets et enfin, la place de l’objet dans la société. De ce fait, on ne peut pas dissocier la décision d’adopter et d’utiliser un objet connecté du questionnement sur le niveau de dévoilement de soi que le client est prêt à concéder. Le facteur clé de succès du développement de l’IoT ne relève donc plus uniquement de l’offre – et des capacités d’innovations technologiques associées – mais également de la qualité de la relation client entre l’entreprise et le client au travers de sa capacité à susciter la confiance de ce dernier à l’égard de l’objet connecté. Il s’agit d’un défi majeur car une défiance de la part du client pourrait susciter des résistances (Mani et Chouk, 2017), telles que des boycotts, des reports d’achat ou des usages sous-optimaux (ex : adoption de technique d’anonymisation, fausses déclarations) qui nuiraient à la qualité des services apportés et dégraderaient les revenus associés. L’exemple de Linky parle de lui-même : un collectif d’opposants au compteur d’électricité communiquant annonce avoir saisi en référé une vingtaine de tribunaux de grandes instances, une manifestation nationale est organisée le 5 mai 2018 et une plateforme de soutien a été mise en ligne (www.mysmartcab.fr).

Figure 1. La chaîne de la connectivité de l’IoT

Les leviers de création d’une relation de confiance : application de la théorie de la justice à la connectivité de l’IoT

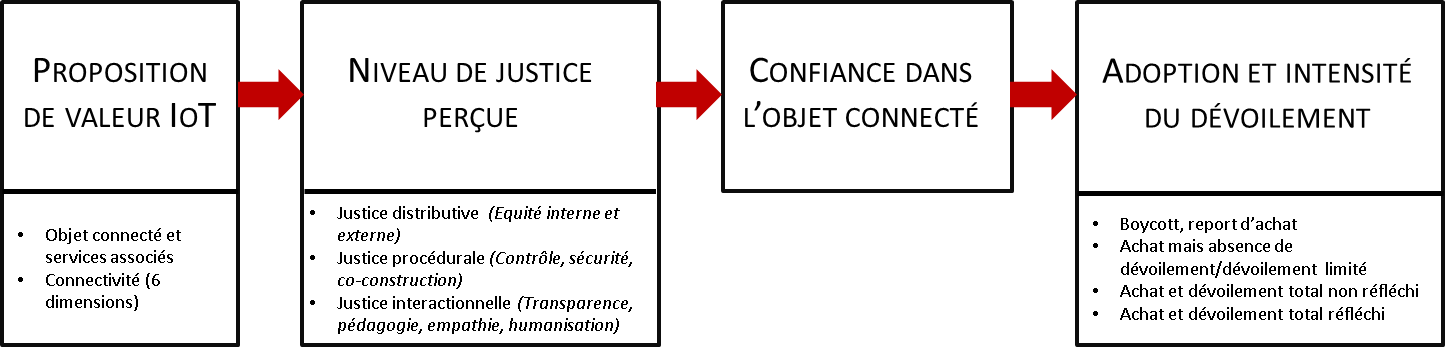

Comment les entreprises peuvent-elles créer une relation de confiance avec leurs clients lorsqu’il s’agit d’IoT ? La confiance provient avant tout d’une relation avec l’entreprise que l’usager doit considérer comme équitable et juste. Dans cet article, nous utilisons une grille de lecture s’appuyant sur la théorie de la justice (Ashworth & Free, 2006) afin d’identifier les leviers à actionner pour susciter la confiance du client en l’objet connecté et ainsi, favoriser son adoption et son usage. La théorie de la justice considère trois dimensions à l’origine du sentiment de justice ou d’équité : la dimension distributive, la dimension procédurale et la dimension interactionnelle (eg. Colquitt et al., 2001). Cette théorie a souvent été mobilisée dans le domaine du marketing relationnel pour appréhender les insatisfactions client (Tax, Brown & Chandrashekaran 1998 ; Prim-Allaz & Sabadie 2005). Elle nous semble donc particulièrement bien adaptée au cas de l’IoT où la connectivité implique que la relation entre le client et l’objet connecté se définisse par l’échange de données qu’elle génère. Le modèle proposé (cf. figure 2) peut être utilisé par les entreprises pour mettre en place des pratiques responsables concernant la politique de données au moyen d’une relation client créatrice de confiance et de valeur. Pour les chercheurs, ce modèle conceptuel présente l’avantage d’identifier de façon systématique les antécédents à la confiance dans le cas des données personnelles captées par les objets connectés et proposer des pistes de recherche à approfondir. Développons chacune des 3 dimensions dans le contexte de la connectivité dans l’IoT.

Figure 2. Proposition d’un modèle de l’adoption des objets connectés et de l’intensité du dévoilement de soi

La justice distributive, au service d’une relation équitable

La dimension distributive s’inscrit dans le cadre de la théorie de l’échange en posant la question de la contrepartie que l’individu peut obtenir en cédant ses données personnelles lors de l’utilisation d’un objet connecté. Le partage de valeur doit être équitable entre l’entreprise et le client, qu’il s’agisse d’équité interne ou d’équité externe.

L’équité interne appliquée à la connectivité de l’IoT

L’équité perçue par le client repose premièrement sur le niveau d’équité interne, défini comme l’écart entre la contribution apportée par le client et les bénéfices retirés. Le calcul coût/bénéfice s’applique pleinement au dévoilement des données personnelles comme le montrent les travaux sur la sollicitation de données auprès de consommateurs qui témoignent de l’existence d’un privacy calculus, processus dans lequel le client évalue les coûts liés au dévoilement de ses données et le compare aux gains associés à ce même dévoilement afin de prendre la décision de communiquer ses données à l’entreprise. Par exemple, les travaux de Dinev & Hart (2006) et de Son & Kim (2008) montrent que plus une entreprise offre des bénéfices au client, plus celui-ci dévoile des données personnelles. Aussi, Lancelot Miltgen (2006, 2009) et Lancelot Miltgen et Gauzente (2006) explorent les différentes natures de facteurs (e.g. facteurs individuels, situationnels et perceptuels) explicatifs du dévoilement de soi sur internet et de ses formes (e.g. intention de répondre, répondre partiellement, mentir, etc.). Appliquer la notion de justice distributive à la connectivité de l’IoT nécessite donc de s’interroger sur les coûts et sur les bénéfices perçus par le client à dévoiler ses données lorsqu’il utilise de tels dispositifs.

Il existe de trois principaux types de bénéfices à accepter qu’un objet collecte des données personnelles. Premièrement, les services utiles que nous obtenons en contrepartie de nos données personnelles (bénéfices dits instrumentaux ou utilitaires) : par exemple, le compteur communiquant Linky propose d’utiliser les données de consommation d’énergie du client pour réduire sa facture ou encore l’offre Smart Building de Schneider Electric qui permet aux entreprises de réduire leur consommation d’énergie en adaptant l’éclairage et le chauffage au nombre de personnes dans les locaux déterminé au moyen de badges connectés. Ces bénéfices dépassent parfois l’individu pour profiter à l’ensemble de la société. Par exemple, dans le secteur agricole, les données collectées par des drones ou par des capteurs installés dans les champs permettent aux agriculteurs d’optimiser la consommation d’eau ou encore la diffusion de pesticides. Idem en ce qui concerne la ville intelligente où les poubelles connectées pourraient permettre d’optimiser la collecte des ordures et réaliser des gains opérationnels et financiers considérables. Deuxièmement, des bénéfices de nature hédoniste ou sociale comme c’est le cas dans le secteur des montres connectées, où le client peut partager ses données de performance sportive avec des proches et ainsi montrer ses exploits, voire initier une joyeuse compétition, s’encourager mutuellement lui offrant un espace d’exposition de soi et de connexion avec sa communauté. Troisièmement, des bénéfices éthiques peuvent également être présents comme par exemple dans les programmes d’IoT mettant en avant le bénéfice sociétal de la collecte de données en particulier dans le secteur de la santé. Par exemple, le site www.patientlikeme.com propose au client de transmettre ses données de santé, qui pourraient demain être collectées par des objets connectés comme des glucomètres ou des cardio-fréquence-mètres, afin de faire progresser la recherche et de pouvoir échanger avec des patients atteintes des mêmes maladies. Ces bénéfices, qu’ils soient instrumentaux, hédonistes ou éthiques, doivent évidemment augmenter en fonction de la nature des données confiées, du volume transmis mais aussi du nombre d’acteurs avec qui ces données seront partagées.

Concernant les coûts liés au dévoilement de soi, ils peuvent être associés à différents types de risques comme le risque de piratage de données sensibles. Par exemple, en octobre 2016, des hackers ont réussi à utiliser une faille de sécurité présente dans certains objets connectés comme des imprimantes, des thermostats ou des webcams pour pirater le site de la société Dyn et bloquer pendant plusieurs heures des sites comme Twitter, Paypal ou Spotify. Le risque d’exploitation abusive des données personnelles effrayent également les clients. Par exemple, le 25 juillet 2017, le directeur exécutif de iRobot annonce à Reuters que les données collectées par leurs aspirateurs (données sur la maison, les meubles et leur disposition) pourraient être vendues aux GAFA et que celle décision est conforme aux conditions générales d’utilisation. Certes, la société a fait demi-tour mais ce type d’annonces renforce le sentiment de vulnérabilité des usagers d’objets connectés. Enfin, les risques d’erreurs opérationnelles (par exemple, qui serait responsable si mon enfant appuie par erreur sur mon dash button commandant 400 boites de lessive ?), soulèvent de nombreuses questions notamment auprès des assureurs d’objets connectés. Ces risques peuvent prendre une dimension géopolitique importante par exemple dans le cas des données agricoles qui pourraient être exploitées par des états ou des grands groupes pour racheter les meilleures terres.

L’équité externe appliquée à la connectivité de l’IoT

La justice distributive comporte une seconde facette, l’équité externe, où un individu perçoit qu’il est traité avec équité par l’entreprise s’il estime qu’il reçoit autant que d’autres personnes, clientes de l’entreprise ou pas, dans des situations comparables. La difficulté dans le cas de l’IoT provient du traitement des données et de l’intelligence artificielle qui prétend, grâce au machine learning, apprendre les comportements du client et ainsi s’adapter et apporter des réponses hyper-personnalisées. Or, par essence, hyper personnalisation signifie discrimination et inégalité d’offre. Dès lors, comment régler ce dilemme d’une hyper personnalisation qui constitue un réel bénéfice pour l’usager mais qui à la fois peut susciter la méfiance car ses fondements ne sont pas explicables ? La question soulevée montre que la justice distributive ne suffit pas seule à susciter la confiance et les actions associées doivent donc se combiner avec celles des deux autres dimensions.

La justice procédurale, au service d’une relation fluide

La justice procédurale consiste à s’assurer que les procédures mises en place par l’entreprise répondent aux besoins du client que ce soit en termes de vitesse, d’accessibilité ou encore de simplicité des parcours client, l’idée étant de réduire au maximum les désagréments pour l’utilisateur. L’application de cette justice procédurale à l’IoT fait écho à de nombreuses questions que se posent le client et qui, si elles sont mal adressées, peuvent freiner l’adoption de l’IoT : Puis-je accéder facilement à mes données afin de les effacer ou de les compléter ? Cet accès est-il facile et rapide ? Est-ce que mon avis est pris en compte lors de la définition des procédures ? Puis-je choisir la manière dont je veux gérer la connectivité de mes objets ? De quel niveau de contrôle et de personnalisation je dispose ? Plus globalement, vais-je avoir la main sur mes objets connectés et en particulier sur mes données personnelles ? Ces questionnements font écho à la manière dont la littérature définit le concept de protection et de respect de la vie privée à savoir « la capacité de l’individu à contrôler la collecte et l’utilisation de ses informations personnelles » (Westin, 1967), « le droit pour les individus de déterminer la nature et l’étendue avec lesquelles les informations les concernant peuvent être communiquées aux autres » (Westin, 1967) ou encore « la capacité de l’individu à contrôler personnellement les informations le concernant » (Stone et al., 1983) ». De ce fait, pour être en ligne avec les piliers de la justice procédurale, les procédures associées aux programmes d’IoT doivent répondre à plusieurs critères.

Le contrôle de la connectivité de l’objet

Premièrement, les interfaces entre l’objet et l’usager doivent permettre à ce dernier de contrôler la connectivité de l’objet que ce soit au niveau de la collecte de données, au niveau de leur partage avec des tiers ou au niveau de leur accessibilité. Par exemple, le client doit pouvoir suspendre ou limiter la collecte de données quand il le souhaite et a minima, être informé quand la collecte de données est en cours. De même, en ce qui concerne l’interfaçage avec les autres objets ou opérateurs, le client doit pouvoir décider avec qui il partage ses données. Sur ce dernier point, la situation est floue. Les entreprises ont deux stratégies : soit se protéger au travers de la notice en précisant au client que les données collectées pourront être partagées (Les pages « Assistance-FAQs » de iRobot ont été largement complétées dans ce sens après le tollé provoqué par la déclaration du directeur exécutif d’iRobot mentionnée plus haut) ; soit s’engager à ne jamais vendre les données des clients à des tiers, comme le fait par exemple Axa. Aucune de ces deux stratégies ne donnent le contrôle au client sur le partage de ses données avec des tiers puisqu’à aucun moment, on ne lui demande son avis. Enfin, le client doit pouvoir accéder à ses données, les effacer ou les enrichir s’il le souhaite de manière simple et rapide et de manière plus nuancée qu’une désinscription au programme, comme c’est le cas aujourd’hui. De nombreuses start-up, comme Nogging, ont investi le sujet en proposant des interfaces de VRM (Vendor Relationship Management), concept introduit par Searls en 2006. Ces interfaces reposent sur des plateformes de gestion de données personnelles au travers desquels les individus ont le contrôle sur les informations qu’ils décident de partager avec différents prestataires. Cette approche est en accord avec les attentes des consommateurs pour qui le problème n’est pas tant la collecte des données mais la peur de perdre le contrôle quant à leur utilisation.

La sécurité de la connectivité grâce à la fiabilité de l’architecture technique

Deuxièmement, le client doit être rassuré quant à la fiabilité de l’architecture technique, que ce soit au niveau de la sécurisation des données personnelles qu’au niveau de l’éthique des algorithmes et de l’intelligence artificielle embarqués dans l’objet. Sur ce dernier point, les entreprises peuvent se mettre en conformité avec les recommandations du rapport de l’eurodéputée Mady Delvaux adopté en plénière le 16 février 2016 notamment en ce qui concerne la loyauté des algorithmes (certifier que les algorithmes font vraiment ce pourquoi ils ont été conçus), leur redevabilité (définir les responsabilités dans les processus algorithmiques) et leur acceptabilité (garantir que la société et les consommateurs acceptent les services et les produits en limitant les processus discriminatoires et injustes cités précédemment). Sur ce dernier point, il est intéressant de noter que certaines entreprises ont limité leur recours au machine learning pour garder le contrôle sur l’exploitation des données et éviter les discriminations implicites.

La co-construction de la connectivité

Troisièmement, la justice procédurale met en avant la dimension de co-construction des procédures en intégrant l’avis des usagers. Cette dimension dépasse le seul paramétrage de la connectivité de l’objet puisqu’elle propose au client d’être acteur de l’offre développée à l’image des expériences proposées dans la distribution comme le site www.mystarbuckideas.com sur lequel le client peut contribuer à la définition de l’offre.

La justice interactionnelle, au service d’une relation authentique

La justice interactionnelle vise à s’assurer que les relations entre l’entreprise et le client soient honnêtes, respectueuses, empathiques et pédagogues. Appliquer la notion de justice interactionnelle à l’objet connecté fait écho aux questions que peut se poser le client sur la nature de ses interlocuteurs lors de ses échanges avec les interfaces (à qui le client parle ? A un chatbot ? A un algorithme ? A une personne ?), sur la manière dont l’empathie peut exister dans une relation intermédiée par des interfaces, sur le sens du mot honnêteté à l’heure de l’intelligence artificielle (comment l’entreprise peut-elle offrir au client des garanties sur un système qu’elle ne contrôle pas ?) ou encore sur le niveau de compréhension qu’il doit avoir (quel équilibre entre transparence et lisibilité ? Jusqu’où faut-il expliquer sans dégrader l’expérience de l’utilisateur) ? Trois pistes émergent des nouveaux programmes mis en place.

Transparence et pédagogie sur la connectivité

Tout d’abord, en écho au rapport de Mady Delvaux évoqué plus haut, gagner la confiance du client passe par mettre en place des relations dominées par la transparence (ex : expliquer au client comment les algorithmes sont utilisées dans la conception et la commercialisation des produits et des services, avertir le client quand il parle avec un chatbot) et la pédagogie (ex : s’assurer que les décisions algorithmiques sont comprises par les opérationnels et les clients). A ce titre, la mission d’éducation de l’entreprise est essentielle notamment auprès de clients non avertis qui ignorent le fonctionnement de l’objet et les démarches à suivre pour limiter sa connectivité et se protéger.

L’empathie pour se connecter à l’objet

Deuxièmement, le développement des objets connectés affectifs, capables d’empathie, ouvre la voie vers un nouveau type d’attachement avec l’objet (Devillers 2017). Précisons que l’attachement avec le robot existe même sur des objets peu sophistiqués comme des robots aspirateurs auxquels les propriétaires donnent un prénom ou les robots démineurs utilisés par l’armée de terre qui sont enterrés comme des soldats à part entière lorsqu’ils sont endommagés par des mines (Tisseron, 2015). Concernant les robots empathiques, plusieurs projets sont déjà en place comme la peluche robot Paro et montrent des résultats probants, justifiant que l’empathie à sa place dans l’IoT. Il convient de souligner que de nombreux travaux en cours cherchent à développer la conversation entre l’usager et l’objet au moyen de la voix.

L’humanisation de la connectivité avec l’entreprise

Troisièmement, l’humanisation de la relation entre le client et l’objet connecté, au travers de dispositifs phygitaux par exemple, est un levier important de confiance. L’offre développée par Docapost est à ce titre très intéressante : le programme IoT développé à l’attention des personnes en perte d’autonomie combine objets connectés et visite du facteur à la personne.

La nécessité d’adapter les leviers identifiés au profil de client

La variété des leviers identifiés ci-dessus et leur imbrication rendent compliqués leur déploiement par les entreprises. Il convient ici de préciser que l’enjeu n’est pas de tous les déployer mais d’identifier le meilleur mix en fonction des profils de clients. En effet, on peut distinguer plusieurs niveaux de réponses dépendant de l’intensité du dévoilement de soi désiré par le client et ainsi définir 4 profils principaux. Premièrement, les réfractaires appartiennent à la cible potentielle du produit mais boycottent l’objet connecté en dépit de son utilité car ils refusent de se dévoiler, le trouvant trop intrusif par rapport aux bénéfices espérés. Deuxièmement, les résistants achètent l’objet mais choisissent de ne pas se dévoiler en bloquant la connectivité de l’objet et en l’utilisant de manière sous-optimale pour des bénéfices qui peuvent être autant utilitaires (écouter de la musique avec l’enceinte Google Home) que statutaires (être trendy grâce à mon Apple Watch). Lorsqu’ils fournissent des informations, celles-ci sont peu nombreuses, transformées (ex : utilisation d’un pseudonyme en place des noms et prénoms), voire perverties (ex : date de naissance erronée). C’est d’ailleurs ce que recommande la CNIL (2017) pour les objets demandant ouverture d’un compte en ligne. Troisièmement, les naïfs achètent l’objet connecté et dévoilent l’intégralité des données captées par l’objet sans s’interroger sur leur nature, leur stockage et leur exploitation. Quatrièmement, les connaisseurs achètent l’objet connecté, utilisent pleinement sa connectivité en dévoilant leurs données mais en pleine conscience de l’échange de données qui en résulte. A leur initiative, l’échange de données peut être temporairement interrompu. L’enjeu pour l’entreprise est alors de transformer les réfractaires et les résistants en connaisseurs (probablement à grand effort de pédagogie et de mise à disposition d’outils de contrôle), de choyer les connaisseurs (probablement au moyen d’une redistribution généreuse des gains liés au partage de leurs données personnelles) ou encore d’éduquer les naïfs afin qu’ils ne deviennent pas réfractaires à la suite d’un incident ou d’un mouvement médiatique.

Recommandations et pistes de recherche

Dans cet article, nous avons développé l’idée que la capacité à susciter la confiance du client à l’égard de l’objet connecté est un critère clé de succès pour les entreprises de l’IoT. L’approche proposée met en lumière la multiplicité des facettes à intégrer pour développer cette confiance du client. Les entreprises doivent veiller à ne pas limiter la confiance à une dimension procédurale au moyen d’actions techniques et juridiques mais doivent s’interroger en profondeur sur la nature de la relation client qu’elles mettent en place. L’importance de la justice distributive doit amener les entreprises à se questionner sur le partage de la création de valeur, qu’il soit utilitaire, hédonistes ou éthique. De même, la justice interactionnelle doit amener les entreprises à repenser la notion d’empathie et d’intégrité notamment à travers la mise en place d’une véritable conversation authentiquement soucieuse du bien-être du client. Parmi les futures recherches qui peuvent être envisagées, il serait intéressant d’identifier le mix de leviers identifiés ayant le plus d’impact sur la propension des clients à adopter et à utiliser l’objet connecté et ce, en fonction de leur profil en introduisant de nouveaux dispositifs de segmentation basés sur l’intensité du dévoilement de soi et le niveau de conscience de l’usager quant à l’exploitation qui peut être faite de ces données. Une segmentation plus fine permettrait aux entreprises de bâtir des programmes d’IoT autour d’une relation client vectrice de confiance et donc de création de valeur.

Bibliographie

Ashworth Laurence & Free Clinton (2006), Marketing Dataveillance and Digital Privacy: Using Theories of Justice to Understand Consumers’ Online Privacy Concerns, Journal of Business Ethics, 67, 107-123

CNIL (2017), https://www.cnil.fr/fr/objets-connectes-noubliez-pas-de-les-securiser

Colquitt J., Conlon D., Wesson M., Porter O., Yee Ng K. (2011), Justice at the Millennium : A Meta-Analytic Review of 25 Years of Organizational Justice Research, Journal of Applied Psychology, Vol 86, N°3, 425-445

Devillers Laurence (2017), Des robots et des hommes, Plon

Dinev T. et Hart P. (2006), An Extended Privacy Calculus Model for E-Commerce Transactions, Information System Research, Vol 17, 61-80

Gartner (2017), https://www.gartner.com/newsroom/id/3598917

IFOP (2015), Etude pour Hiscox sur la perception des français sur les objets connectés, étude menée en ligne auprès de 1 500 individus représentatifs de la population française en novembre 2015

Lancelot Miltgen C. (2006), Dévoilement de soi et réponses du consommateur face à une sollicitation de ses données personnelles : application aux formulaires sur Internet, Thèse de Doctorat en Gestion, Université Paris Dauphine

Caroline Lancelot Miltgen (2009), Propension à fournir des données personnelles mensongères sur Internet : une étude exploratoire. Systèmes d’Information et Management, 14 (3), 9-42

Lancelot Miltgen C. et Gauzente C. (2006), Vie privée et partage de données personnelles en ligne : une approche typologique, Congrès de l’Association Française du Marketing, Nantes

Mani Zied & Inès Chouk (2017) Drivers of consumers’ resistance to smart products, Journal of Marketing Management, 33:1-2, 76-97

Martin Kirsten (2016) Understanding Privacy Online: Development of a Social Contract Approach to Privacy, Journal of Business Ethics, 137:551–569

McKinsey (2016), Car data: paving the way to value-creating mobility Perspectives on a new automotive business model

Parlement européen (2017), Règles de droit civil sur la robotique, Résolution du Parlement européen du 16 février 2017 contenant des recommandations à la Commission concernant des règles de droit civil sur la robotique (2015/2103(INL)

Prim-Allaz I. et Sabadie W. (2005), Les apports de la théorie de la justice à la gestion des réclamations, Décisions Marketing, 38, 7-20

Son et Kim (2008), Internet users information privacy protective responses : A taxonomy and a nomological model, MIS Quaterly, Vol 32, No 3, p 503-529

Stone, Eugene F., Hal G. Gueutal, Donald G. Gardner et Stepherd McClure, A Field Experiment Comparing Information-Privacy Values, Beliefs, and Attitudes Across Several Types of Organizations, Journal of Applied Psychology, vol. 68, no. 3, 1983, pp. 459-468.

Tax S.T., Brown S.W. et Chandrashekaran M. (1998), Customer evaluations of service complaint experiences implications for relationship marketing, Journal of Marketing, 62, April, 60-76

Tisseron Serge (2015), Le Jour où mon robot m’aimera, Vers l’empathie artificielle, Albin Michel

FWestin Alan (1967), Privacy & Freedom, New-York : Atheneum